音声符号化技術の標準化動向

22.2マルチチャンネル音響(以下,22.2ch音響)を用いた8Kスーパーハイビジョン(以下,8K)放送を実現するために,国内では2011年に,総務省令により音声符号化方式の改定が行われた。これにより,高度BS(Broadcasting Satellite)デジタル放送等で22.2ch音響を用いた放送が可能となった。この総務省令では,デジタル放送の音声符号化方式はMPEG-4 AAC(Advanced Audio Coding)規格および ALS(Audio Lossless Coding)規格に準拠する方式とすることが規定された。これに合わせて,電波産業会(ARIB:Association of Radio Industries and Businesses)はARIB STD-B32の改定を行った。この改定により,デジタル放送における音声符号化方式の最大音声入力チャンネル数は「22チャンネルおよび低域を強調する2チャンネル」とされ,適用可能な技術方式としてMPEG-4 AAC規格およびALS規格が追加された。本稿では,これらの標準化の動向や,最新の3次元立体音響のための音声符号化方式等について解説する。

1.はじめに

日本国内において22.2ch音響を用いた8K放送を実現するために,2011年に総務省令第87号「標準テレビジョン放送等のうちデジタル放送に関する送信の標準方式」1) により,音声符号化方式の改定が行われた。これにより,それまでのデジタル放送のチャンネル数が最大5.1ch(5チャンネルおよび低域を強調する1チャンネル)までであったのに対して,高度BSデジタル放送および高度狭帯域・広帯域CS(Communications Satellite)デジタル放送における最大入力音声チャンネル数は22.2ch(22チャンネルおよび低域を強調する2チャンネル)とする改定が行われた。また,音声符号化方式は,高効率な非可逆圧縮符号化方式であるMPEG-4 AAC規格2) および可逆圧縮符号化方式であるMPEG-4 ALS規格3) に準拠する方式とすることが規定された。

この総務省令に対応して,電波産業会はARIB STD-B32「デジタル放送における映像符号化,音声符号化及び多重化方式」の改定4) を行った。この改定により,MPEG-4 AAC音声符号化方式5) に関しては,最大22.2chのマルチチャンネル音声モードに対応した,より詳細な仕様に関する追加規定が行われた。また,MPEG-4 ALS音声符号化方式に関しては,チャンネル数や予測次数などに関する制約条件の追加規定が行われた。

本稿では,これらの国際・国内の標準化動向を解説するとともに,2015年2月に標準化された最新の3次元立体音響のための音声符号化方式であるMPEG-H 3D Audioについても紹介する。

2.22.2ch音響の概要

22.2ch音響は上層・中層・下層の3層のレイヤーに合計24個のチャンネルを配置する3次元立体音響方式である6)。聴取位置の上方に上層の9チャンネル,聴取者の耳の高さに中層の10チャンネル,聴取位置の下方に下層の3チャンネルを配置し,さらに2個の低域効果チャンネル(LFE:Low-Frequency Effects)を加えている。1図に,22.2ch音響のチャンネル配置とチャンネルラベルを示す。

NHKでは,22.2ch音響について,8K放送にふさわしい高臨場感音響方式の要求条件を定め,主観評価を通じて22.2ch音響がその要求条件に合致した方式であることを明らかにし,国内外の標準化に寄与してきた6)。

3.MPEG-4 AAC規格およびALS規格の概要

3.1 音声の圧縮符号化技術

音声信号の圧縮符号化に用いる主要な符号化技術は,次の2通りに分類できる。

- 聴覚の特性を考慮して符号化する方法。この方法は,圧縮しても符号化により発生する劣化が聴感上,全く分からないか,ほとんど分からなくすることができる。

- 波形の予測や統計的な手法を使って音声データに含まれる冗長性を除去する方法。受信データから原信号を完全に再生できる場合には,ロスレス符号化と呼ぶ。

AACは(a)の方法,ALSは(b)の方法に分類される。

3.2 MPEG-4 AACの概要

MPEG-4 AAC は,ISO/IEC(International Organization for Standardization / International Electrotechnical Commission:国際標準化機構/国際電気標準会議)14496-3 Subpart 4内で規格化された。MPEG-4 AACはMPEG-2 AAC(ISO/IEC13818-7)7) をベースに拡張した規格であり,音楽などのオーディオ信号を効率よく符号化できるとともに,モノラルや2chステレオに加えて,22.2ch音響を含むマルチチャンネルの信号を扱うことができる。

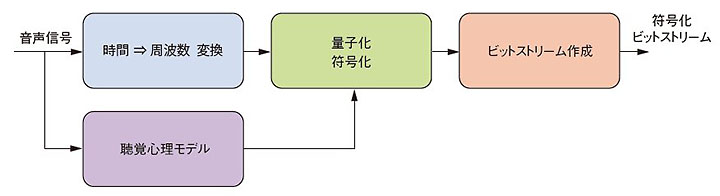

MPEG-4 AACは,音声信号を周波数成分に分解して符号化する「周波数領域の圧縮符号化」の一種であり,マスキング*1 などの人の聴覚の性質を効果的に用いることにより,高能率な圧縮を行う技術である。聴覚の性質を用いた音声符号化のブロック図を2図に示す。音を周波数成分に分解する方法として,MPEG-4 AACではDCT(Discrete Cosine Transform)を用いて直接周波数領域の信号に変換して符号化する「変換符号化」法を採用している。変換符号化を行う際には,時間領域の信号を周波数領域の信号に変換する窓(ブロック)の長さは2,048サンプルを基本とし,細かな時間解像度が必要な場合は256サンプルのブロックに適応的に切り替えを行う。

MPEG-4 AACは複数のオーディオオブジェクトタイプ*2 を持つが,現在放送サービスに使用されているのは,デコーダーの回路規模と音質とのバランスがとれたLC(Low Complexity)のみである。

MPEG-4 AACを用いると,ステレオ信号を約1/12の128~144kbpsに圧縮しても,符号化により発生する劣化を聴感上ほとんど分からなくすることができる。

3.3 MPEG-2 AACとMPEG-4 AACの相違点

MPEG-2 AAC(ISO/IEC 13818-7)とMPEG-4 AAC(ISO/IEC 14496-3 Subpart 4)は,音声信号を高能率に圧縮するツールとしてはほぼ同じものを使用しているが,MPEG-4 AACでは,PNS(Perceptual Noise Substitution)*3 と呼ばれる符号化ツールが追加されている。音声符号化の際に,音声信号を周波数領域の信号に変換したDCT係数を伝送するためには多くのビットレートを必要とするが,PNSはスケールファクターバンド*4 内の信号をバンド全体に対するノイズとして扱い,そのパワー情報などを送る。復号側では,この情報を用いて適正なレベルのノイズを挿入し,音声信号を再構成することによりビットレートを削減できる。

3.4 MPEG-4 ALSの概要

MPEG-4 ALSは,ISO/IEC 14496-3:2007 Amd.2 MPEG-4 Audio Lossless Codingとして2006年3月に規格化された。

MPEG-4 ALSは,前述のロスレス符号化と呼ばれる方式の一種であり,線形予測技術を用いて過去の複数のサンプル値から予測分析を行うことにより,多チャンネル信号や高サンプリングレートの信号に対しても,原信号の波形データを完全に再現することのできる方式である。音声入力信号を分析して線形予測パラメーターと予測残差を算出し,それぞれの信号を可変長符号化することにより,符号化ビットストリームを生成する(3図)。原信号と比較すると予測残差の振幅は一般に小さくなるという特性を利用することで,圧縮前の15~70%程度のデータ量に圧縮することができる。

4.ARIB STD-B32の改訂

高度BSデジタル放送における超高精細度テレビジョン放送に対応するために,ARIB STD-B32においていくつかの改訂が行われた。音声入力信号として22.2chに対応したことに加え,MPEG-4 AAC方式により符号化された22.2ch音響を,5.1ch音響や2chステレオの受信機で復号する場合のダウンミックス*5 のパラメーター,およびこのパラメーターの伝送方式と,将来の放送サービスの拡張のために導入されたダイアログエンハンスメント*6 およびダイアログの差し替え機能*7 が規格化された。さらにMPEG-4 ALS方式に関しては,利用可能なパラメーターを一部制限している。本章では,これらの規格に関して説明する。

なお,MPEG-4音声符号化規格においては,サンプリング周波数やチャンネル数の選択範囲が広いが,総務省令・告示およびARIB標準規格においては,8K放送に用いるサンプリング周波数は48kHz,量子化ビット数は16ビット以上と規定されている。1表に,デジタル放送の各標準方式に適用される音声の技術方式を示す(平成23年総務省令第87号または平成23年総務省令第94号で規定)。

また,MPEG-4音声符号化規格では,2chステレオや5.1ch音響など一般的に用いられる音響システムごとに個別番号が割り当てられている。2表 に,MPEG-4 AACおよびALSで使用可能なチャンネル設定の個別番号とチャンネル数を示す。なお22.2ch音響には,番号13が割り当てられている。

| 地上 デジタル テレビ ジョン 放送 |

V-High マルチ メディア 放送 |

V-Low マルチ メディア 放送 |

BS デジタル 放送 |

高度 BS デジタル 放送 |

狭帯域 CS デジタル 放送 |

広帯域 CS デジタル 放送 |

高度 狭帯域 CS デジタル 放送 |

高度 広帯域 CS デジタル 放送 |

||

|---|---|---|---|---|---|---|---|---|---|---|

| 音声 入力 フォー マット |

標本化周波数 | 32kHz 44.1kHz 48kHz |

32kHz 44.1kHz 48kHz |

32kHz 以上 |

32kHz 44.1kHz 48kHz |

48kHz | 32kHz 44.1kHz 48kHz |

32kHz 44.1kHz 48kHz |

32kHz 44.1kHz 48kHz |

48kHz |

| 最大音声入力 チャンネル数 |

5.1ch | 5.1ch | 5.1ch | 5.1ch | 22.2ch | 5.1ch | 5.1ch | 22.2ch※1 | 22.2ch | |

| 音声 符号化 方式 |

MPEG-2 AAC |

〇 | 〇 | 〇 | 〇 | 〇 | 〇 | 〇 | ||

| MPEG-2 BC※2 |

〇 | |||||||||

| MPEG-4 AAC |

〇 | 〇 | 〇 | 〇 | ||||||

| MPEG-4 ALS |

〇 | 〇 | 〇 | 〇 | ||||||

| チャンネル設定の個別番号 | チャンネル数 |

|---|---|

| 1 | 1ch (1/0) |

| 2 | 2ch (2/0) |

| 3 | 3ch (3/0) |

| 4 | 4ch (3/1) |

| 5 | 5ch (3/2) |

| 6 | 5.1ch (3/2.1) |

| 7 | 7.1ch (5/2.1) |

| 11 | 6.1ch (3/0/3.1) |

| 12 | 7.1ch (3/2/2.1) |

| 13 | 22.2ch (3/3/3-5/2/3-3/0/0+2) |

| 14 | 7.1ch (2/0/0-3/0/2-0/0/0+1) |

| 0 | 3ch (2/1),4ch (2/2) または2音声 (デュアルモノ)(1/0+1/0)の場合 |

・チャンネル数を,「上層(前方/側方/後方)-中層(前方/側方/後方)-下層(前方/側方/後方)+LFE」で表す。

・割り当てチャンネルがない方向は0と表記する。

・ 中層のみによる音声モードの場合は「中層(前方/側方/後方).LFE」,中層のみによるマルチチャンネルステレオの音声モードで側方のチャンネルがない場合は「中層(前方/後方).LFE」と略記する。

4.1 AACのダウンミックス係数の伝送に関わる改訂

5.1chを超えるマルチチャンネルステレオ(チャンネル設定の個別番号=7,11,12,13,14 の各音声モード)からダウンミックスによって2chステレオを得る場合は,一旦5.1chにダウンミックスしてから,2chステレオへダウンミックスする。5.1chから2chステレオへのダウンミックス係数*8 を伝送する場合,ISO/IEC 14496-3:2009/AMD4に記載されたDSE(Data Stream Element)*9 を用いる。

なお,ダウンミックスに関する規格化に際し,NHKでは22.2chから5.1chへのダウンミックスを適正に行うために多数の番組素材を使用した実験8) を行い,推奨されるダウンミックス式とダウンミックス係数のデフォルト値を導出することで,ARIB STD-B32の改定に貢献した。

4.2 AACのダイアログ制御機能に関わる改訂

(1)ダイアログエンハンスメント機能

ダイアログエンハンスメント機能は,ダイアログチャンネル(番組のセリフやナレーションを再生するチャンネル)とそれ以外の背景音チャンネルを番組ごとにフラグによって区別して,ダイアログチャンネルに割り当てられた信号のレベルを,背景音チャンネルの信号から独立して受信機で調節するための機能である。

(2)ダイアログ信号の差し替え機能

ダイアログ信号の差し替え機能は,22.2chの音声信号とは別に差し替え用の追加ダイアログ信号(例えば英語やフランス語のダイアログ)(以下,差し替え音声)を22.2chと同一の音声ストリーム内のユーザー領域(DSE)を用いて伝送し,受信機でダイアログチャンネルにもともと割り当てられていた信号(以下,初期ダイアログ信号)と差し替える機能である。差し替えた音声は,放送局側で選択した1つあるいは複数のチャンネルで再生することができる。また,その場合には,各再生チャンネルの音声レベルも,放送局側でチャンネルごとに(FCは0dB,BtFCは-3dBなどのように)指定することができる。

ダイアログの差し替え機能を持つ受信機は,外部から与えられたダイアログの差し替え命令を受けて,例えば,もともとFCとBtFC(1図参照)に入っていた日本語のダイアログと,英語もしくはフランス語等のダイアログとを差し替える。なお,ダイアログのレベル制御については,ダイアログの差し替え処理後に実施可能である。

これらのダイアログ制御機能を追加する改訂に際し,NHKではMPEG-4 AACのシンタックス(符号化ビットストリームのデータの表現規則)の検討に基づいて,規格改訂案の作成に貢献した。また,同規格に準拠したコーデックの試作も行い,同機能が実現可能なことを示した9)。

4.3 ALSのパラメーター

MPEG-4 ALS規格は最大65,536チャンネルに対応し,線形予測の次数も1,023次まで対応しているが,デジタル放送におけるMPEG-4 ALSの規格においては,最大チャンネル数は22.2ch,最大予測次数は15次などの制約条件を設けている。

5.将来の符号化方式

MPEG-4 AACやALS以外の方式でも,5.1ch以上の再生チャンネル数を使用する3次元立体音響方式が,近年,映画やホームシアターでの再生方式として採用されつつある。例えば,水平面の5.1chのスピーカーに加えて上層にスピーカーを配置するAuro-3Dや,オブジェクトと呼ばれる独立した音声チャンネルの音を他のチャンネルにミキシングして再生できるDolby Atomsなどの3次元立体音響方式がある。本章では,それらの方式のうち,国際標準化が進められている方式として,MPEG-H 3D Audioについて紹介する。

5.1 MPEG Audio規格の最新動向:MPEG-H 3D Audio

MPEGにおいては,ハイビジョン映像を超える4Kや8KのUHD(Ultra High Definition)映像に対応する次世代の音声符号化方式として,MPEG-H 3D Audio10) の規格化が進められている。

MPEG-H 3D Audioは,22.2ch音響のようなマルチチャンネルオーディオをより高能率に符号化し,小空間での現実的な数のスピーカー数(例えば10.1や8.1チャンネル)にレンダリング(各チャンネルのスピーカーに信号を再配分)して再生する技術である。

この規格の主なターゲットとしては,上方に配置されたスピーカーを使用するようなホームシアターをはじめ,パーソナルテレビやスマートホン,タブレット+ヘッドホンなどの視聴形態が含まれる。

MPEG-H 3D Audioの特徴は,MPEG USAC(Unified Speech and Audio Coding)11)*10 およびMPEG SAOC(Spatial Audio Object Coding)12)*11 をベースにした高能率な符号化技術と,複数のレンダリング技術を採用していることである。レンダリングの方法としては,VBAP(Vector Base Amplitude Panning)13)*12 と呼ばれる方法を基本として,レンダリング済みの信号をヘッドホンや異なる配置のスピーカーチャンネルで再生するための技術を組み合わせている。

また,高次アンビソニックスHOA(Higher Order Ambisonics)14) と呼ばれる,音場を球面調和関数*13 の和として展開し,記録・再生する方式も採用されている。

5.2 MPEG-H 3D Audioの音声符号化技術

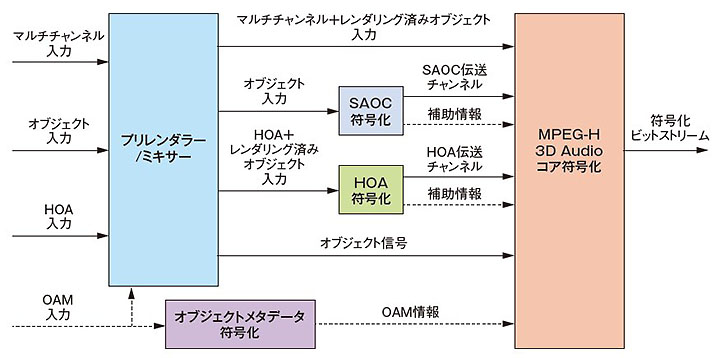

4図にMPEG-H 3D Audio音声符号化のブロック図を示す。チャンネルベース*14 の信号として扱えるオブジェクトは,プリレンダラーにより,あらかじめレンダリングしてから符号化することで符号化効率を改善する。一方,受信機側で再生位置などを変える可能性のあるオブジェクトは,モノラル信号のまま符号化器に供給され,受信機側でレンダリングとミキシングが行われる。また,MPEG SAOC等の技術を利用して,複数のオブジェクトをまとめて扱い,伝送するチャンネル数を少数化して,データ数を減らすことにより,符号化効率を改善している。コア符号化のブロックでは,AACで採用されているSCE(Single Channel Element)*15,CPE(Coupling Channel Element)*16 に加えて,QCE(Quad Channel Element)*17 を採用することで効率化を図っている。さらに,OAM(オブジェクトメタデータ)情報*18 も効率良く符号化することのできる方式となっている。

6.おわりに

本稿では,8K放送を実現するための音声符号化技術の標準化動向として,総務省令およびARIB規格の改定について述べ,高度BSデジタル放送等において,MPEG-4 AAC規格および ALS規格に準拠する方式により,22.2ch音響の放送サービスが可能となったことを紹介した。また,ARIB規格の改定に関しては,新たな放送サービスにつながるダウンミックスやダイアログ制御機能などについて説明した。さらに,3次元立体音響の最新の音声符号化方式であるMPEG-H 3D Audioに関して,標準化動向を解説した。NHKでは,今後もこうした国内外の標準化に寄与していく予定である。